로컬 LLama LLM AI 채팅 쿼리 도구

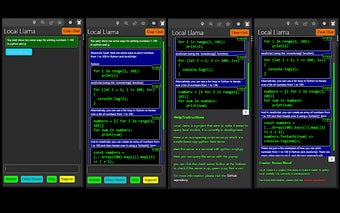

로컬 LLama LLM AI 챗 쿼리 도구와 함께 웹 브라우징 경험을 향상시켜보세요. 이 혁신적인 크롬 확장 프로그램은 귀하의 서버에 호스팅된 로컬 모델과 원활하게 상호작용할 수 있도록 설계되었습니다. 이 혁신적인 도구를 사용하면 브라우저 내에서 손쉽게 로컬 모델에 대한 쿼리를 실행하고 정확도를 높일 수 있습니다.

Llama CPP 및 .gguf 모델과 호환되는 이 확장 프로그램은 모델링 요구에 다양한 솔루션을 제공합니다. 시작하려면 최신 버전에 액세스하여 편리하게 사용할 수 있는 Llama CPP Flask 서버 샘플을 확인하세요. 이 확장 프로그램은 제공된 Python 스크립트를 실행하고 몇 가지 간단한 단계로 확장 프로그램을 설치할 수 있는 사용자 친화적인 인터페이스를 제공합니다. Local LLama LLM AI 챗 쿼리 도구를 사용하면 브라우저 기반 모델 상호작용의 미래를 오늘 경험할 수 있습니다.